„Eine gute Forschungsfrage ist entscheidend, um sich beim Text Mining nicht zu verirren“

- Top-Meldungen

- Forschung

- Reihen & Dossiers

Im Forschungszentrum DoCMA betreiben Sie mithilfe von Text Mining Big Data-Analysen von Zeitungsartikeln und Social Media. Was ist der Mehrwert von Text Mining für die Forschung?

Der Mehrwert besteht darin, dass man sich nicht auf kleine Stichproben beschränken muss, sondern inhaltliche Vollerhebungen machen kann – etwa alle Artikel, die in einer Zeitung über einen Zeitraum von 25 Jahren erschienen sind. Bei klassischen händischen Inhaltsanalysen wäre das viel zu aufwendig. Dank Text Mining kann man die Entwicklung der Berichterstattung über lange Zeiträume für ganze Medien und sogar Gattungen nachvollziehen. Millionen Artikel werden gleichzeitig analysiert. Das ist nicht nur für die Journalismusforschung interessant, sondern auch für die Ökonomik, da sich diese inhaltlichen Analysen zu Zeitreihen verdichten lassen, die wiederum als Inputs für ökonometrische Modelle dienen können. Als ich vor zwölf Jahren an die TU Dortmund kam, hätte ich nicht gedacht, dass wir so weit kommen und Text Mining so faszinierend ist.

Wie könnten andere Fachbereiche von Text Mining profitieren?

Text Mining wird bereits in vielen Bereichen betrieben, wie ich gelernt habe etwa auch im Biochemieingenieurwesen. Es wird vielfach eingesetzt, um bei der Flut an wissenschaftlichen Veröffentlichungen den Überblick zu behalten. Das DoCMA ist interdisziplinär aufgestellt: Wir sind Kommunikationswissenschaftler oder wie ich Ökonomen, und wir profitieren sehr von der Zusammenarbeit mit Kollegen in der Statistik, insbesondere Prof. Carsten Jentsch und Prof. Jörg Rahnenführer sowie deren wissenschaftlichen Mitarbeiterinnen und Mitarbeitern. Wir stehen in ständigem Austausch. Seit einiger Zeit explodiert im Bereich Text Mining das Wissen. In einem kürzlich von uns veröffentlichten Paper kombinieren wir von uns weiterentwickelte Topic-Modeling-Verfahren mit Large Language Models (LLM), um damit die narrativen Inhalte großer Textkorpora besser offenlegen zu können. Die maschinelle Infrastruktur, die wir hier an der TU Dortmund haben mit dem Hochleistungsrechner Lido 3 und ganz neu Lido 4, ist dabei eine große Unterstützung.

Was würden Sie jemandem aus einem anderen Fachbereich empfehlen, der mit Text Mining starten möchte?

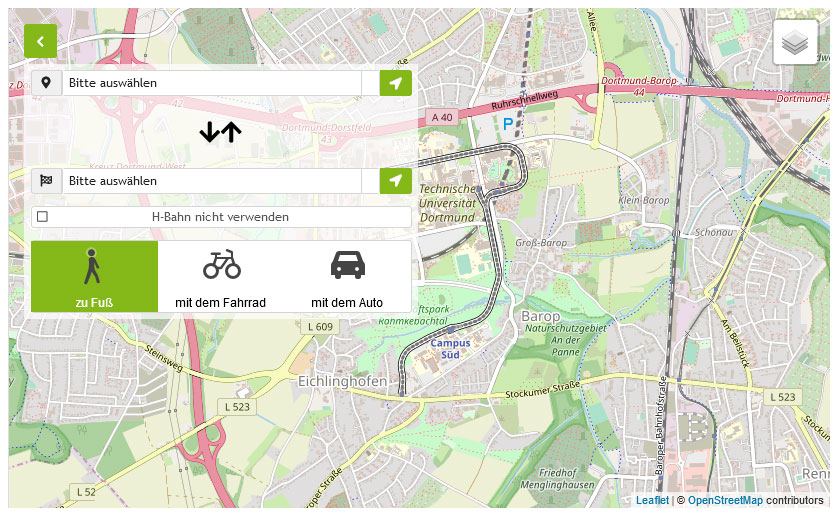

Forschende können sich direkt an die Beratungsstelle Text und Data Mining der Universitätsbibliothek an der TU Dortmund wenden, dort gibt es kompetente Ansprechpersonen, die alle Fragen beantworten und umfassende Hilfestellungen für den Zugang zu den Texten bieten. Zentral ist, eine gute und konzise Forschungsfrage zu formulieren. Wenn Sie nicht wissen, was Sie eigentlich herausfinden wollen, dann verirren Sie sich leicht beim Text Mining. Relevante Forschungsfragen herauszuarbeiten ist eine Kompetenz, die wir als Journalistikforscher und -lehrer einbringen. Interessante Fragen zu stellen ist ja gewissermaßen der Kern des Journalismus. Bei den Methoden hingegen tun wir uns schwerer. Bei manchen mathematisch ausgerichteten Kollegen ist es wiederum umgekehrt. So ergänzen wir uns vortrefflich. Ich würde übrigens immer davor warnen, Text Mining betreiben und dabei möglichst keine Texte lesen zu wollen, weil man Lesen für zu subjektiv hält. Aus meiner Sicht liefern Text-Mining-Tools erstmal nur Hinweise. Ohne die inhaltliche Auseinandersetzung mit repräsentativen Texten, das sogenannte „Close Reading“, kommt man nicht weiter. Ist dieses Text-Cluster, das mir der Algorithmus hier auswirft, kohärent oder ist das Kauderwelsch? Halluziniert mein LLM gerade irgendwelche Inhalte? Wenn Sie die Modelle nicht richtig kalibrieren, dann kommt dabei nichts Sinnvolles heraus. Am Ende arbeiten wir mit menschlicher Sprache, und dafür ist immer noch das menschliche Gehirn das adäquate Analyse-Instrument.

Wieviel Programmierwissen ist erforderlich?

Für Text Mining braucht man nicht unbedingt fortgeschrittene Programmierkenntnisse. Unsere vorherige Doktorandengeneration hat ein R-Paket geschrieben: Tosca (Tools for Statistical Content Analysis). Damit haben schon eine Menge Studierende Analysen für ihre Abschlussarbeiten gemacht. Es gibt inzwischen so vielfältige Anwendungen, das erleichtert die inhaltliche Arbeit enorm.

Zur Person:

- seit Oktober 2013 Professor für wirtschaftspolitischen Journalismus an der TU Dortmund

- seit 2015 Sprecher des Dortmund Center for data-based Media Analysis (DoCMA)

- seit 2019 Mitinitiator der UA Ruhr-übergreifenden Narrative Economics Alliance Ruhr (NEAR)

- seit 2025 Mitglied im Kuratorium des Dortmund Center for Data Science and Simulation (DoDaS)

Weitere Informationen:

- DoCMA – Informationen über das DoCMA, inkl. Ressourcen wie R-Packages für Text Mining

- Beratungsstelle Text und Data Mining der Universitätsbibliothek

- DoDaS – Informationen zum Forschungszentrum und zur Mitgliedschaft